这里想和大家分享一下o1复现的一些关键思考过程。

原标题:Kimi技术大牛复盘:k1.5复现o1的思考过程

文章来源:智猩猩GenAI

内容字数:7066字

Flood Sung:o1复现的关键思考过程

本文是Flood Sung对o1复现过程的思考总结,分享了其Long Chain of Thoughts (Long CoT) 的关键步骤和思考。文章的核心在于如何训练模型像人一样思考,最终实现AGI。

1. Long CoT 的有效性与反思

o1发布后效果震撼,其Long CoT的有效性引发了作者的反思。作者回忆起一年多前Tim @周昕宇的实验,使用小型模型训练几十位加减乘除运算,并将其合成Long CoT数据进行SFT,取得了显著效果。这验证了Long Context的重要性,但当时由于成本和速度的考量,Long CoT并未被优先考虑。

2. 训练模型思考的关键

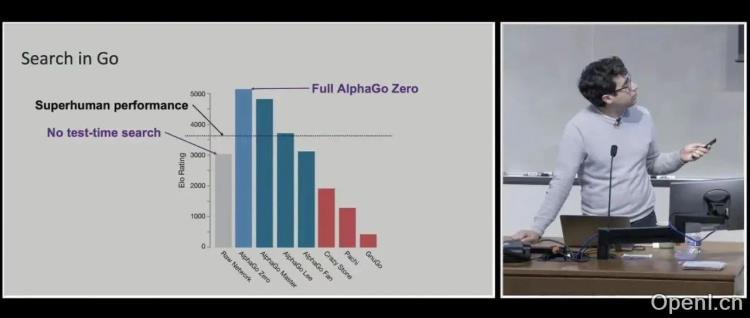

为了理解o1的工作机制,作者分析了o1官网的例子,发现其可以犯错,并通过反思和尝试改进。o1的思考方式灵活多样,包括重述问题、联想和分治等。Noam Brown和Hyung Won Chung的OpenAI视频为作者提供了重要启示:Noam Brown强调了Test-Time Search的重要性,指出模型需要自行搜索;Hyung Won Chung强调“Don’t Teach,Incentivize”,指出人为添加结构化inductive bias会限制模型能力,Agentic Workflow只有短期价值。作者由此得出结论:需要训练模型像人一样思考。

3. 基于精确Reward的RL训练

Noam Brown的PPT强调了进行精确Reward的RL训练的重要性,避免Reward Model的限制。作者指出,RL的性能完全取决于Reward,而以往的RLHF由于Human Preference难以精准建模,容易出现Reward hacking。因此,作者选择使用具有标准答案的数学和代码题作为训练数据。

作者分析了o1的训练过程,认为其实际上是“In Context RL with Self-Critique”,将完整的trajectory作为message输入模型。模型在Long CoT下进行next token prediction,学习解决问题,其输出轨迹包含一系列action和reward。由于模型自我反思,难以精确估计每个step的value,作者最终选择将问题建模为Contextual Bandit问题,使用REINFORCE的变种进行训练。训练过程中,模型的token数会随着性能提升而增加,这是RL训练过程中模型涌现的能力。

4. AGI近在眼前

作者总结了整个思考过程,认为通过RL训练LLM进行Long CoT解题,并通过Contextual Bandit解决value估计难题,最终实现了o1的复现。作者相信AGI近在眼前,未来的发展方向是将这种方法应用到更复杂的场景中,例如模拟驾驶、内容创作和应用开发等。

联系作者

文章来源:智猩猩GenAI

作者微信:

作者简介:智猩猩旗下账号,专注于生成式人工智能,主要分享技术文章、论文成果与产品信息。