ENEL – 上海 AI Lab 推出的无编码器3D大型多模态模型

ENEL是什么

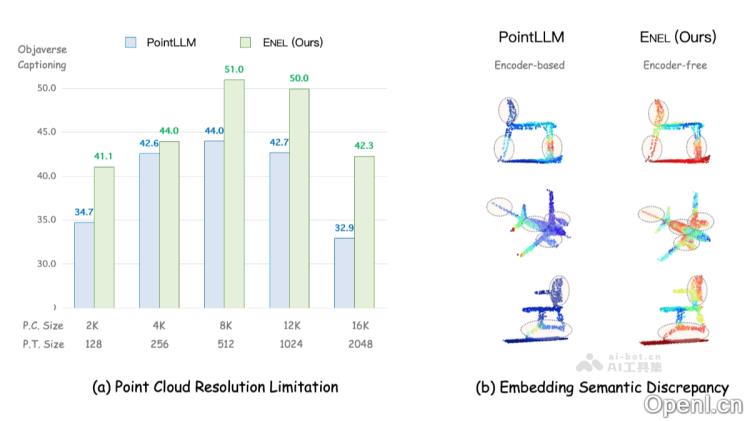

ENEL(Exploring the Potential of Encoder-free Architectures in 3D LMMs)是一款创新的无编码器3D大型多模态模型(3D LMM),旨在克服传统编码器在3D理解任务中的局限性。通过省略3D编码器,ENEL能够将点云数据直接转换为离散的点标记,并与文本标记结合,随后输入大型语言模型(LLM)。该模型采用两种关键策略,以实现高效的语义编码与几何结构理解:首先,利用LLM嵌入的语义编码策略,通过混合语义损失提取高级语义;其次,采用分层几何聚合策略,使LLM能够关注点云的局部细节。

ENEL的7B模型在多个3D任务中表现优异,包括3D对象分类、3D对象字幕生成和3D视觉问答(VQA)。在Objaverse基准测试中,ENEL-7B的字幕生成任务GPT分数达到50.92%,分类任务达到55.0%,在3D MM-Vet数据集的VQA任务中达到42.7%,与现有的13B模型(如ShapeLLM)不相上下。ENEL的无编码器架构在语义编码方面表现卓越,更好地捕捉了点云与文本之间的语义关联性。

ENEL的主要功能

- 无编码器设计:ENEL摒弃了传统3D编码器,直接将点云数据通过标记嵌入模块转换为离散点标记,并与文本标记拼接后输入到LLM中。这一设计有效避免了编码器结构中常见的点云分辨率限制及语义嵌入不匹配问题。

- 高级语义提取:ENEL通过LLM嵌入的语义编码策略,在预训练阶段引入混合语义损失(Hybrid Semantic Loss),从而提取点云的高级语义特征,同时保持重要的几何结构信息。

- 局部几何感知:在指令调优阶段,ENEL采用分层几何聚合策略,使LLM能够主动感知点云的局部细节。通过聚合和传播操作,将局部几何信息融入LLM的早期层,进而实现对复杂3D结构的细致理解。

- 多任务3D理解:ENEL在多个3D任务中表现出色,包括3D对象分类、3D对象字幕生成和3D视觉问答(VQA)。其7B模型在Objaverse基准测试中达到了55.0%的分类准确率和50.92%的字幕生成GPT分数,性能与13B的ShapeLLM相当。

- 高效语义对齐:ENEL通过无编码器架构实现了点云与文本模态之间的高效语义对齐,更好地捕捉两者之间的语义关联,为3D多模态任务提供了强大的语义基础。

ENEL的技术原理

- LLM嵌入的语义编码(LLM-embedded Semantic Encoding):在预训练阶段,ENEL探索不同的点云自监督损失(如掩码建模损失、重建损失、对比损失和知识蒸馏损失),提出了混合语义损失(Hybrid Semantic Loss),将点云的高级语义信息嵌入到LLM中,替代传统3D编码器的功能。

- 分层几何聚合(Hierarchical Geometry Aggregation):在指令调优阶段,ENEL引入分层几何聚合策略,通过在LLM早期层内对点云进行聚合和传播,融入归纳偏置,关注点云的局部细节。具体而言,使用最远点采样(FPS)和k近邻(k-NN)算法对点云进行下采样和聚合,逐步整合点云的细粒度语义信息。

ENEL的项目地址

- GitHub仓库:https://github.com/Ivan-Tang-3D/ENEL

- arXiv技术论文:https://arxiv.org/pdf/2502.09620

ENEL的应用场景

- 3D对象分类:ENEL能够高效地对3D对象进行分类,适用于工业自动化、机器人视觉和自动驾驶等领域,快速识别和分类复杂的3D物体。

- 3D对象字幕生成:可生成对3D模型的描述性文本,帮助用户迅速理解3D场景中的关键信息,适用于虚拟现实(VR)、增强现实(AR)及3D建模工具。

- 3D视觉问答(VQA):能够回答与3D场景相关的问题,例如在医学影像分析、建筑设计和教育领域中,帮助用户快速获取3D数据中的关键信息。

- 复杂3D几何结构理解:适用于需要精确理解复杂几何形状的领域,如航空航天、汽车制造和珠宝设计,帮助工程师和设计师更好地理解及优化3D模型。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号