MakeAnything 标志着 AI 从 “生成结果” 迈向 “生成过程” 的关键一步。

原标题:炒菜、雕刻、绘画、汽车人变形!MakeAnything用扩散Transformer解锁多任务过程生成

文章来源:机器之心

内容字数:5757字

新加坡国立大学MakeAnything:AI分步创作的突破

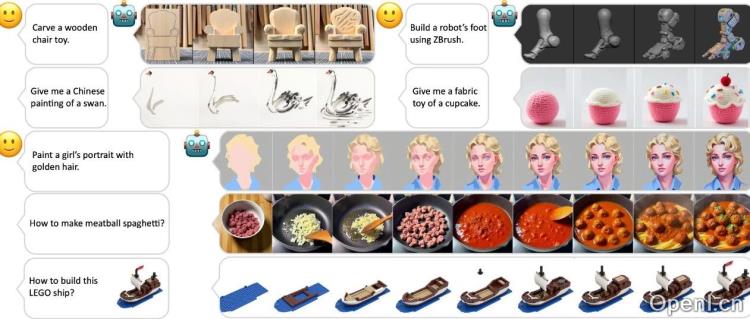

本文介绍了新加坡国立大学最新研究MakeAnything,该研究首次实现了高质量、跨领域的程序化序列生成,让AI学会像人类一样分步骤创作复杂作品,例如绘画、手工艺和烹饪等。

1. 挑战与解决思路

让AI生成步骤教程面临三大挑战:多任务数据稀缺、步骤间逻辑连贯性不足以及跨领域泛化能力有限。MakeAnything通过构建大规模多领域数据集、激活DiT的上下文能力和采用非对称LoRA技术,解决了这些难题。

2. 技术详解

MakeAnything的核心技术包括:

- 蛇形拼图与DiT:利用扩散Transformer (DiT) 的空间注意力机制,将多步骤帧排列成蛇形网格,强化模型对步骤顺序的感知,避免逻辑断层和外观漂移。

- 非对称LoRA:在所有数据集上微调共享矩阵A,学习通用知识和分步骤逻辑;对不同任务微调单独矩阵B,适配具体任务特性,平衡通用知识与特定任务效果,提升跨任务泛化能力。

- ReCraft模型:利用变分自编码器(VAE)编码目标图像特征,指导DiT去噪过程,实现从“成品图”反推创作过程,特别适合逆向工程或从简单图像创造详细教程的场景。

- 新任务泛化:MakeAnything展现了在新任务上的出色泛化能力,即使在未见过的任务上也能生成相对合理的结果,这归因于不同任务间的共通性。

3. 实验结果与评估

MakeAnything采用CLIP Score评估图文一致性,用GPT-4和人工评估连贯性和有用性。对比实验显示,MakeAnything在图文一致性、逻辑连贯性和有用性上均优于现有方法。消融实验验证了非对称LoRA的有效性,它在兼顾过程合理性和图文一致性方面表现出色。

4. 结论

MakeAnything是AI从“生成结果”迈向“生成过程”的关键一步,其代码、模型和数据集已开源,为过程生成领域的研究和应用提供了有力支撑。

联系作者

文章来源:机器之心

作者微信:

作者简介:专业的人工智能媒体和产业服务平台

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号