Sitcom-Crafter – 北航联合港中文等高校推出的 3D 人类动作生成系统

Sitcom-Crafter是什么

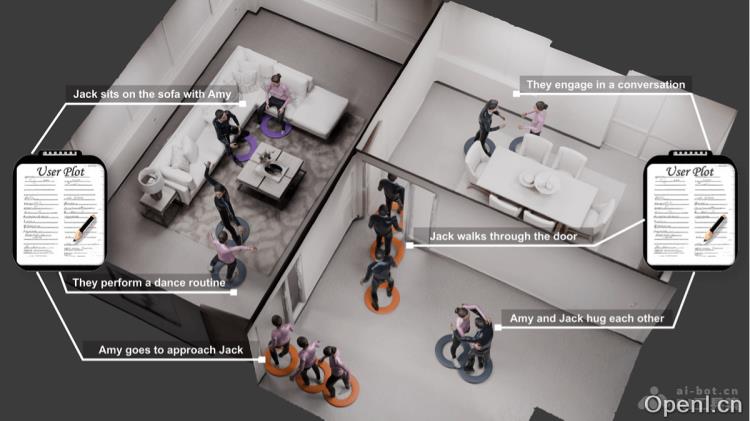

Sitcom-Crafter 是由北京航空航天大学、香港中文大学(深圳)、悉尼科技大学和中山大学等多所高校共同研发的一个3D场景人类动作生成系统。该系统能够根据用户提供的长篇剧情引导,智能生成丰富多样且符合物理规律的动作表现,涵盖人类行走、人与场景的互动,以及人类之间的交互。Sitcom-Crafter 由八个模块组成,其中三个核心模块专注于动作生成,五个增强模块则致力于优化动作的流畅性、同步性和碰撞修正等方面。其创新的3D场景感知技术和自监督签名距离函数(SDF)策略,能够在无需额外数据采集的情况下生成符合物理逻辑的动作,极大地提升了创作效率,为动画和游戏设计提供了高效、智能化的解决方案。

Sitcom-Crafter的主要功能

- 人类行走:角色在3D环境中自然行走,展现真实的动态表现。

- 人类与场景交互:角色与环境中的物体进行符合物理规律的互动。

- 人类之间交互:生成角色间协调的动作,减少碰撞并优化动作的同步性。

- 增强功能:

- 剧情解析:AI自动分析剧本,将其转化为具体的角色动作指令。

- 同步:确保不同模块生成的动作在时间上保持一致性。

- 手部姿态增强:通过检索数据库中的手部姿态,提升的自然性。

- 碰撞修正:自动检测并修正角色之间的碰撞。

- 3D重定向:将生成的动作映射至现有的3D数字角色模型,以提升视觉效果。

Sitcom-Crafter的技术原理

- 生成模块:

- 人类行走生成:借助前沿技术(如GAMMA),通过深度学习模型生成角色的行走动作。

- 人与场景交互生成:根据DIMOS等方法,结合场景信息生物与环境物体的交互。

- 人与人交互生成:采用自监督的场景感知方法,合成3D场景中的SDF点,以模拟周围环境,从而避免角色与场景间的碰撞,并基于扩散模型生成多人交互,考虑角色之间的相对位置和。

- 场景感知技术:

- SDF点合成:基于预处理的数据,定义区域并随机生成周围物体的SDF点,以模拟场景中的障碍物。

- 碰撞检测与修正:SDF点检测角色与场景或彼此之间的碰撞,调整轨迹或速度以避免碰撞。

- 剧情理解与指令生成:利用大型语言模型(如Gemini 1.5)解析剧情文本,将其转化为具体的指令。通过自然语言处理技术,将复杂剧情分解为多个命令,并分配给相应的生成模块。

- 增强模块:

- 同步:通过插值技术(如Slerp)确保不同模块生成的在时间上平滑过渡。

- 手部姿态检索:CLIP模型检索与文本描述最相似的手部姿态,并融入生成的中。

- 碰撞修正:调整速度或路径,以避免角色间的碰撞。

- 3D重定向:将生成的映射到高质量的3D数字角色模型,提升视觉效果。

- 统一的表示:系统采用标记点作为统一的表示,支持从不同数据源(如SMPL、SMPL-X模型)提取数据,增强系统的扩展性和兼容性。

Sitcom-Crafter的项目地址

- 项目官网:https://windvchen.github.io/Sitcom-Crafter/

- GitHub仓库:https://github.com/WindVChen/Sitcom-Crafter

- arXiv技术论文:https://arxiv.org/pdf/2410.10790

Sitcom-Crafter的应用场景

- 动画制作:迅速生成角色动作,减少手动动画的工作量,支持多样化动作和剧情驱动的动画设计。

- 游戏开发:为非玩家角色设计自然行为和交互动作,支持动态剧情生成和实时动作反馈,提升游戏的沉浸感。

- 虚拟现实(VR)和增强现实(AR):生成虚拟角色的自然交互和场景模拟,增强用户体验及交互的自然性。

- 影视制作:用于早期创意验证、特效场景设计和动作捕捉替代,提升制作效率。

- 教育与培训:生成模拟训练中的角色行为,创建虚拟教学助手,支持安全演示和复杂场景的教学。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号