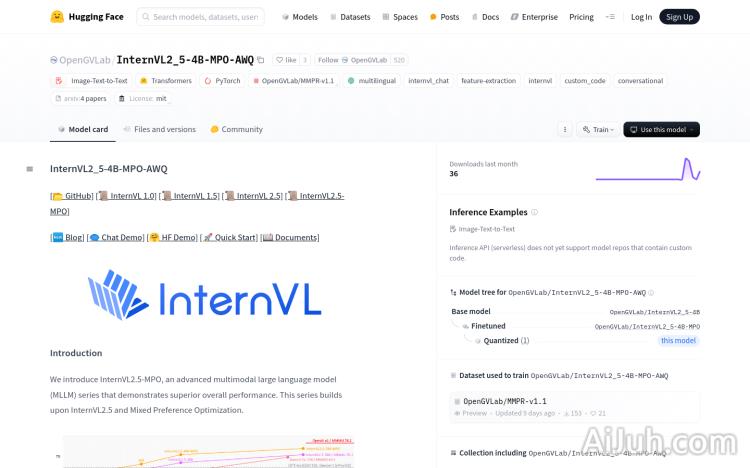

InternVL2_5-4B-MPO-AWQ官网

InternVL2_5-4B-MPO-AWQ是一个多模态大型语言模型(MLLM),专注于提升模型在图像和文本交互任务中的表现。该模型基于InternVL2.5系列,并通过混合偏好优化(MPO)进一步提升性能。它能够处理包括单图像和多图像、视频数据在内的多种输入,适用于需要图像和文本交互理解的复杂任务。InternVL2_5-4B-MPO-AWQ以其卓越的多模态能力,为图像-文本到文本的任务提供了一个强大的解决方案。

InternVL2_5-4B-MPO-AWQ是什么

InternVL2_5-4B-MPO-AWQ是一个强大的多模态大型语言模型,它能够理解和处理图像和文本信息,并在此基础上进行各种任务。它基于InternVL2.5系列模型,并通过混合偏好优化(MPO)技术进一步提升了性能。这意味着它不仅能理解图像内容,还能将图像信息与文本信息结合起来,完成更复杂的任务,例如图像描述生成、图像问答等。简单来说,它就像一个拥有“火眼金睛”和“妙笔生花”的大语言模型。

InternVL2_5-4B-MPO-AWQ主要功能

InternVL2_5-4B-MPO-AWQ的主要功能在于处理图像和文本的交互任务。它可以进行图像描述生成、图像问答、图像内容理解、多图像理解以及视频理解等。其优势在于能够高效地处理多种模态的数据,并结合这些数据提供更准确、更全面的结果。例如,它可以根据一张商品图片生成详细的产品描述,也可以根据一段视频生成相应的文本摘要。

如何使用InternVL2_5-4B-MPO-AWQ

使用InternVL2_5-4B-MPO-AWQ需要一定的技术基础。大致步骤如下:首先,需要安装必要的依赖包,例如lmdeploy;然后,加载模型,指定模型名称’OpenGVLab/InternVL2_5-4B-MPO-AWQ’;接着,准备输入数据,可以是文本或图像文件;之后,使用pipeline函数将模型和输入数据结合进行推理;最后,获取模型输出的结果并进行后续处理。对于多图像或多轮对话,需要根据文档调整输入格式。如果需要部署模型为服务,可以使用lmdeploy的api_server功能。更详细的使用方法,请参考官方文档。

InternVL2_5-4B-MPO-AWQ产品价格

目前,关于InternVL2_5-4B-MPO-AWQ的具体价格信息并未公开。由于这是一个开源模型,用户可以免费下载和使用,但实际应用中可能需要考虑计算资源成本。

InternVL2_5-4B-MPO-AWQ常见问题

该模型的计算资源需求如何? 该模型参数量较大,需要一定的计算资源才能运行。具体需求取决于任务复杂度和输入数据大小,建议使用高性能GPU进行推理。

如何处理模型输出结果中的错误? 模型的输出并非总是完美无缺,可能存在一定的错误。用户需要根据实际情况进行判断和修正,并可以尝试调整模型参数或输入数据来提高准确性。

模型的适用范围有多广? 该模型适用于各种需要图像和文本交互理解的任务,例如图像描述生成、图像问答、视觉问答等。其适用范围广泛,但具体效果取决于任务的复杂性和数据的质量。

InternVL2_5-4B-MPO-AWQ官网入口网址

https://huggingface.co/OpenGVLab/InternVL2_5-4B-MPO-AWQ

OpenI小编发现InternVL2_5-4B-MPO-AWQ网站非常受用户欢迎,请访问InternVL2_5-4B-MPO-AWQ网址入口试用。

数据评估

本站OpenI提供的InternVL2_5-4B-MPO-AWQ都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 1月 9日 上午9:52收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。

粤公网安备 44011502001135号

粤公网安备 44011502001135号