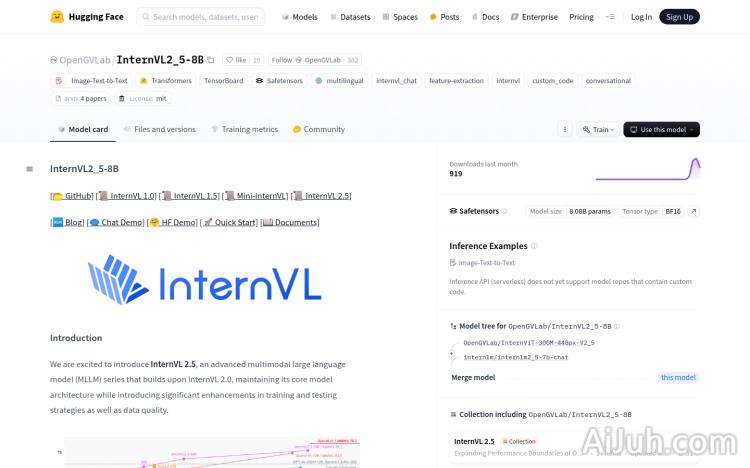

InternVL2_5-8B

InternVL2_5-8B官网

InternVL2_5-8B是由OpenGVLab开发的一款多模态大型语言模型(MLLM),它在InternVL 2.0的基础上进行了显著的训练和测试策略增强,以及数据质量提升。该模型采用’ViT-MLP-LLM’架构,集成了新增量预训练的InternViT与多种预训练语言模型,如InternLM 2.5和Qwen 2.5,使用随机初始化的MLP projector。InternVL 2.5系列模型在多模态任务上展现出卓越的性能,包括图像和视频理解、多语言理解等。

InternVL2_5-8B是什么

InternVL2_5-8B是由OpenGVLab开发的多模态大型语言模型(MLLM),它基于InternVL 2.0进行了改进,在训练策略、数据质量和模型架构上都有显著提升。它采用“ViT-MLP-LLM”架构,结合了InternViT视觉编码器和InternLM 2.5、Qwen 2.5等预训练语言模型,能够理解图像和文本之间的交互关系,并完成多种多模态任务,例如图像描述、图像问答、多语言图像标注和视频理解等。

InternVL2_5-8B主要功能

InternVL2_5-8B的主要功能在于其强大的多模态理解能力。它可以同时处理图像和文本信息,并进行复杂的交互式理解。具体功能包括:图像描述生成、图像问答、多语言图像标注与分类、视频内容理解与分析等。此外,它还具备较强的语言理解能力,支持多种语言。

如何使用InternVL2_5-8B

使用InternVL2_5-8B需要一定的编程基础。首先,需要安装必要的库,如PyTorch和Transformers。然后,从Hugging Face平台加载模型和分词器。接下来,准备输入数据,包括图像(需要预处理,调整大小并转换为模型需要的格式)和文本。最后,使用模型进行推理,并分析结果。整个过程需要熟悉Python编程和深度学习相关的知识。

InternVL2_5-8B产品价格

目前,关于InternVL2_5-8B的具体价格信息并未公开。它可能以开源的方式提供,用户可以免费使用,但需要自行承担计算资源成本。也可能存在商业授权或付费服务,具体情况需参考OpenGVLab的官方信息。

InternVL2_5-8B常见问题

InternVL2_5-8B的运行需要哪些硬件资源? 该模型参数量较大,运行需要强大的计算资源,例如高性能GPU(例如A100或H100)以及足够的内存和存储空间。具体资源需求取决于任务的复杂性和输入数据的规模。

如何评估InternVL2_5-8B的性能? 可以根据具体的应用场景选择合适的评估指标。例如,在图像描述任务中,可以使用BLEU、ROUGE等指标;在图像分类任务中,可以使用准确率、召回率、F1值等指标。OpenGVLab也提供了该模型在多个基准数据集上的性能评估结果。

InternVL2_5-8B支持哪些语言? InternVL2_5-8B支持多种语言,具体支持的语言范围需要参考官方文档或Hugging Face模型页面上的说明。其多语言能力来源于其在多语言数据集上的预训练。

InternVL2_5-8B官网入口网址

https://huggingface.co/OpenGVLab/InternVL2_5-8B

OpenI小编发现InternVL2_5-8B网站非常受用户欢迎,请访问InternVL2_5-8B网址入口试用。

数据评估

本站OpenI提供的InternVL2_5-8B都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 1月 9日 上午10:20收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。