Wan2.1-T2V-14B官网

Wan2.1-T2V-14B 是一款先进的文本到视频生成模型,基于扩散变换器架构,结合了创新的时空变分自编码器(VAE)和大规模数据训练。它能够在多种分辨率下生成高质量的视频内容,支持中文和英文文本输入,并在性能和效率上超越现有的开源和商业模型。该模型适用于需要高效视频生成的场景,如内容创作、广告制作和视频编辑等。目前该模型在 Hugging Face 平台上免费提供,旨在推动视频生成技术的发展和应用。

Wan2.1-T2V-14B是什么

Wan2.1-T2V-14B是一款强大的开源文本到视频生成模型。它基于扩散变换器架构,结合了创新的时空变分自编码器(VAE)和大规模数据训练,能够根据文本或图像生成高质量的视频。支持中文和英文,并且在性能和效率上都优于许多现有的模型。它适用于内容创作、广告制作、视频编辑等多种场景,目前在Hugging Face平台上免费提供。

Wan2.1-T2V-14B主要功能

Wan2.1-T2V-14B的主要功能包括文本到视频生成、图像到视频生成。它支持多种分辨率(480P和720P),并具备强大的时空压缩能力,可以高效处理1080P视频。此外,它还支持中文和英文文本输入,扩展了应用场景。

Wan2.1-T2V-14B如何使用

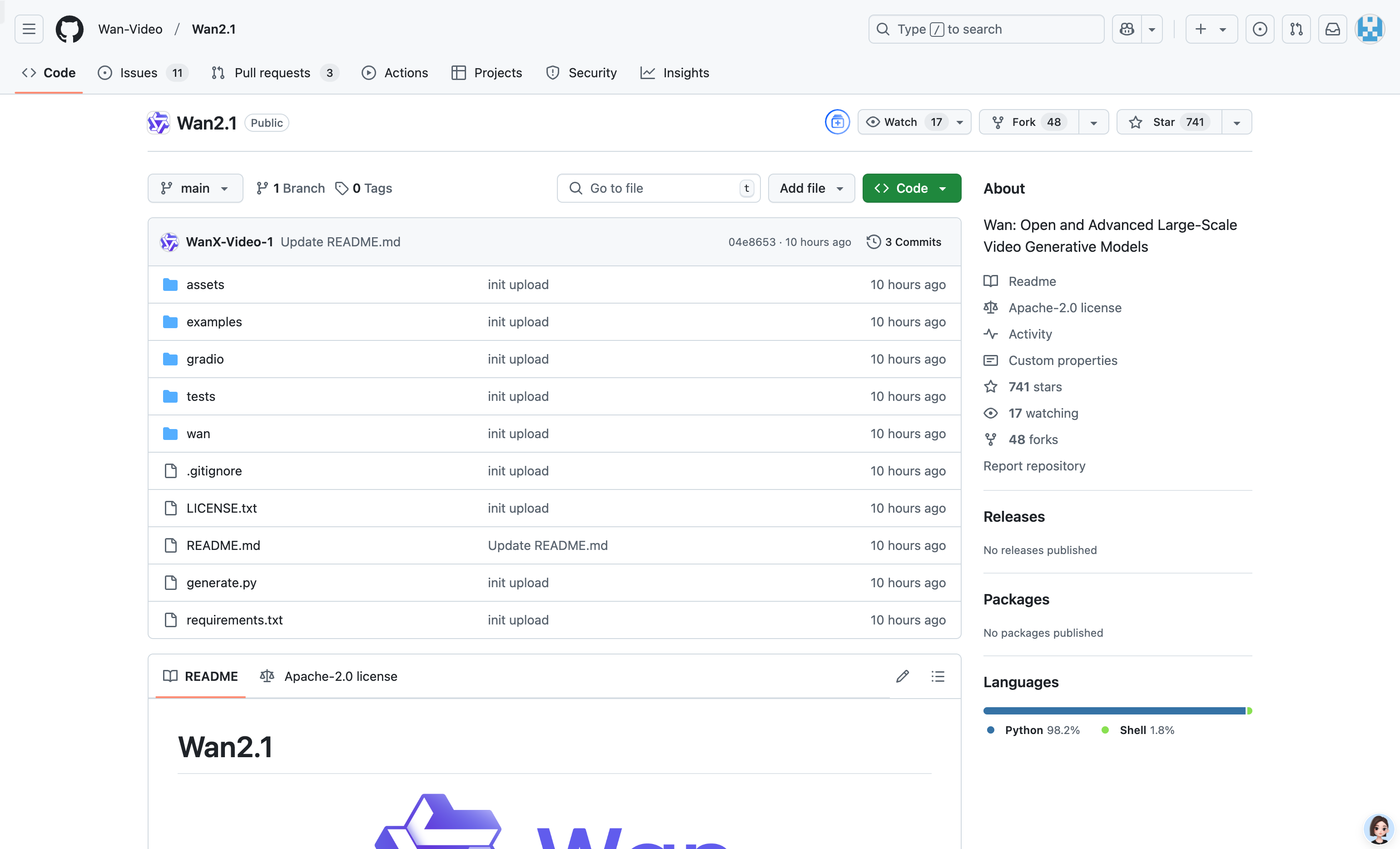

使用Wan2.1-T2V-14B非常方便,只需要按照以下步骤操作:

- 克隆项目仓库:

git clone https://github.com/Wan-Video/Wan2.1.git - 安装依赖:

pip install -r requirements.txt - 下载模型权重:

huggingface-cli download Wan-AI/Wan2.1-T2V-14B --local-dir ./Wan2.1-T2V-14B - 运行文本到视频生成:

python generate.py --task t2v-14B --size 1280*720 --ckpt_dir ./Wan2.1-T2V-14B --prompt '描述文本'(将’描述文本’替换成你的文本提示) - 根据需要调整参数,例如分辨率、提示文本等。

Wan2.1-T2V-14B产品价格

Wan2.1-T2V-14B是一个开源模型,完全免费使用。

Wan2.1-T2V-14B常见问题

我的电脑配置不够高,能运行Wan2.1-T2V-14B吗?

该模型提供单GPU和多GPU推理代码,你可以根据自己的硬件配置选择合适的版本。即使是单GPU,也能生成相对高质量的视频,只是生成速度可能较慢。

生成的视频质量如何?

生成的视频质量取决于你的文本提示的质量和模型的训练数据。一般来说,清晰简洁的提示能得到更好的结果。模型本身已经经过大规模数据训练,能够生成高质量的视频。

如果遇到错误,该如何解决?

请仔细检查你的代码和参数设置,确保已正确安装依赖项并下载模型权重。你可以在Hugging Face社区或GitHub项目页面上寻求帮助,许多用户会分享他们的经验和解决方案。

Wan2.1-T2V-14B官网入口网址

https://huggingface.co/Wan-AI/Wan2.1-T2V-14B

OpenI小编发现Wan2.1-T2V-14B网站非常受用户欢迎,请访问Wan2.1-T2V-14B网址入口试用。

数据评估

本站OpenI提供的Wan2.1-T2V-14B都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由OpenI实际控制,在2025年 3月 17日 下午7:20收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,OpenI不承担任何责任。