AIGC动态欢迎阅读

原标题:NeurIPS 2023|有效提高视频编辑一致性,美图&国科大提出基于文生图模型新方法EI²

文章来源:机器之心

内容字数:6217字

内容摘要:

机器之心专栏

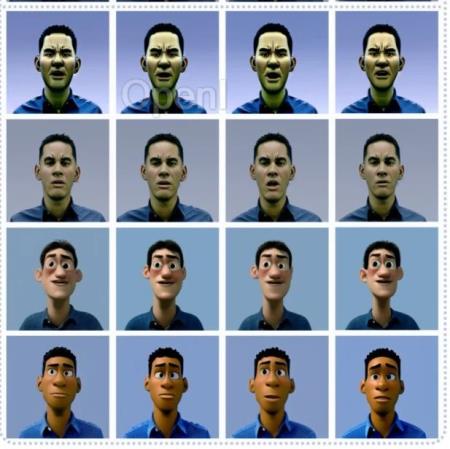

机器之心编辑部美图影像研究院(MT Lab)与中国科学院大学突破性地提出了基于文生图模型的视频生成新方法 EI2,用于提高视频编辑过程中的语义和内容两方面的一致性。该论文从理论角度分析和论证视频编辑过程现的不一致的问题,主要由引入的时序信息学习模块使特征空间出现协变量偏移造成,并针对性地设计了新的网络模块进行解决以生成高质量的编辑结果。目前,该论文已被机器学习顶会之一 NeurIPS 2023 接收。

背景

作为当前炙手可热的前沿技术之一,生成式 AI 被广泛应用于各类视觉合成任务,尤其是在图像生成和编辑领域获得了令人赞叹的生成效果。对比静态图像,视频拥有更丰富的动态变化和语义信息,而现有的视觉生成任务主要基于变分自编码器(VAE)和生成对抗网络(GAN),但通常会受限于特定场景和数据,很难提供普适的解决方案。因此,近年来基于扩散模型(Diffusion Models)在分布式学习上表现出的卓越能力,扩散模型也开始被拓展到视频领域,并在视频生成与编辑领域展现出了巨大的潜力。

在研究初期,基于扩散模型的视频生成和编辑任务利用文本 – 视频数据集直接训练文生视频模型以达到

原文链接:点此阅读原文:NeurIPS 2023|有效提高视频编辑一致性,美图&国科大提出基于文生图模型新方法EI²

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...