AIGC动态欢迎阅读

原标题:CVPR 2024 | 分割一切模型SAM泛化能力差?域适应策略给解决了

关键字:编码器,下游,模型,权重,数据

文章来源:机器之心

内容字数:9669字

内容摘要:

机器之心专栏

机器之心编辑部第一个针对「Segment Anything」大模型的域适应策略来了!相关论文已被CVPR 2024 接收。引言

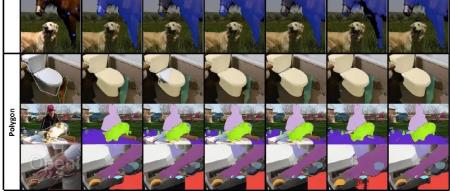

大语言模型(LLMs)的成功激发了计算机视觉领域探索分割基础模型的兴趣。这些基础分割模型通常通过 Prompt Engineer 来进行 zero/few 图像分割。其中,Segment Anything Model(SAM)是最先进的图像分割基础模型。图 SAM 在多个下游任务上表现不佳

但是最近的研究表明,SAM 在多种下游任务中并非具有很强的鲁棒性与泛化性,例如在医学图像、伪装物体、添加干扰的自然图像等领域表现较差。这可能是由于训练数据集与下游的测试数据集之间存在较大的域差异(Domain Shift)所致。因此,一个非常重要的问题是,如何设计域自适应方案,使 SAM 在面对现实世界和多样化的下游任务中更加鲁棒?

将预训练好的 SAM 适应到下游任务主要面临三个挑战:

首先,传统的无监督域自适应范式需要源数据集和目标数据集,由于隐私和计算成本较为不可行。

其次,对于域适应,更新所有权重通常性能更好,同时也受到了昂贵的内存成本的限制。

最后,

原文链接:CVPR 2024 | 分割一切模型SAM泛化能力差?域适应策略给解决了

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...