AIGC动态欢迎阅读

原标题:替代MLP的KAN,被开源项目扩展到卷积了

关键字:卷积,参数,架构,函数,线性

文章来源:机器之心

内容字数:3867字

内容摘要:

机器之心报道

机器之心编辑部本月初,来自 MIT 等机构的研究者提出了一种非常有潜力的 MLP 替代方法 ——KAN。

KAN 在准确性和可解释性方面表现优于 MLP,而且它能以非常少的参数量胜过以更大参数量运行的 MLP。比如,作者表示,他们用 KAN 以更小的网络和更高的自动化程度重现了 DeepMind 的结果。具体来说,DeepMind 的 MLP 有大约 300000 个参数,而 KAN 只有大约 200 个参数。

KAN 与 MLP 一样具有强大的数学基础,MLP 基于通用逼近定理,而 KAN 基于 Kolmogorov-Arnold 表示定理。

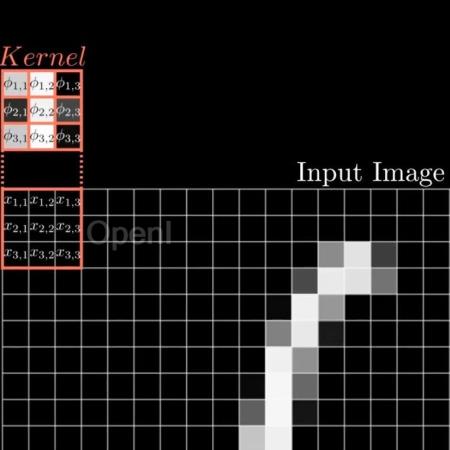

如下图所示,KAN 在边上具有激活函数,而 MLP 在节点上具有激活函数。KAN 似乎比 MLP 的参数效率更高,但每个 KAN 层比 MLP 层拥有更多的参数。最近,有研究者将 KAN 创新架构的理念扩展到卷积神经网络,将卷积的经典线性变换更改为每个像素中可学习的非线性激活函数,提出并开源 KAN 卷积(CKAN)。项目地址:https://github.com/AntonioTepsich/Convolutional-KANs

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号