AIGC动态欢迎阅读

内容摘要:

来源:清熙

一.大模型的推理能力

现在的大模型是茶壶里煮饺子,从预训练中学习了很多,但简单粗暴的采样推理的方式却限制了它的能力输出。

正如在降低大模型幻觉的必由之路一文中笔者建议的:大模型技术还在日新月异的发展,即使大模型永远不会停止幻觉, 在未来,专业系统会验证LLM输出,针对特定环境优化的人工智能工具将部分取代今天的通用模型。

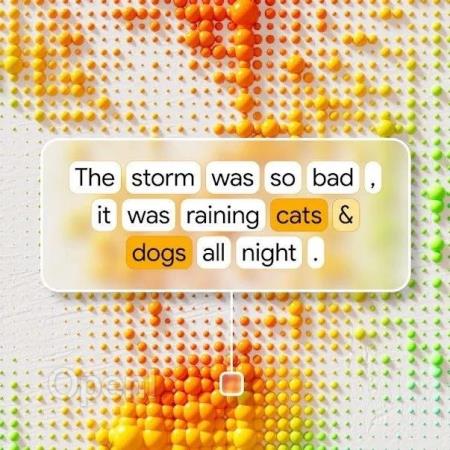

其中最重要的改进方向就是,通过引导大模型学习人类特定的先验,更好地理解“范畴的结构和关系”,优化范畴内和跨范畴采样算法,将幻觉降低到“不可见”范围,尽管很难消除为零。

近期大模型行业的动向也印证了笔者这一判断。时代周刊全球百大AI人物& Cohere创始人接受采访时讲“AI模型还没有真正的问题解决能力,是因为训练语料里面很少有记录人类推理的过程。所以像Cohere, OpenAI 和Anthropic 等大模型领先的公司都在想尽办法搜集展示人类推理的数据”。

笔者去年年初在 ChatGPT是第一个真正意义的人工通用智能中阐释过,目前研究已经证明GPT对知识有强大的记忆能力。而增强GPT推理能力的方法:a) 提供提示语或提示样本 b) 预训练中引入代码

原文链接:如何提升大模型推理能力

联系作者

文章来源:人工智能学家

作者微信:

作者简介:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号