AIGC动态欢迎阅读

原标题:50s完成7B模型量化,4bit达到新SOTA,大模型低比特量化有新招了 | NeurIPS 2024 Oral

关键字:矩阵,权重,模型,通道,作者

文章来源:量子位

内容字数:0字

内容摘要:

DuQuant团队 投稿量子位 | 公众号 QbitAI消除激活值(outliers),大语言模型低比特量化有新招了——

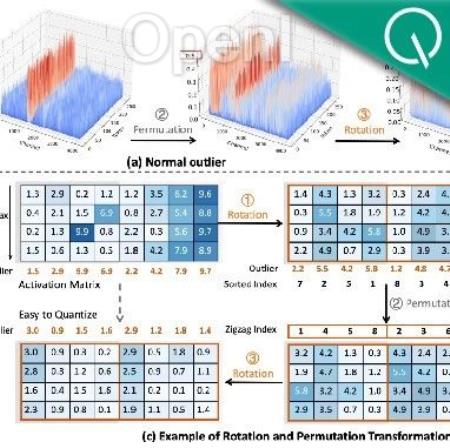

自动化所、清华、港城大团队最近有一篇论文入选了NeurIPS 2024(Oral Presentation),他们针对LLM权重激活量化提出了两种正交变换,有效降低了outliers现象,达到了4-bit的新SOTA。

简单理解,在大语言模型(LLM)中,有一些中间层输出的数值(激活值 Activation)会变得非常大,它们被称为“outliers(离群值)”,这些 outliers给模型量化带来了挑战。

补充一下,量化可以将模型中的数值从浮点数转换为整数,以减少模型的大小和计算需求。

而一旦在量化过程中存在大量outliers,会导致量化后的模型性能下降。

明白了这层道理, 我们再来看他们团队的一项名为DuQuant的新研究。

首先, 他们发现在LLM的前馈网络 (FFN) 模块中的down_proj层, 存在明显的Massive Outliers(非常大的激活值)。

这种outliers不同于以往发现的Normal Outliers,表现为大于绝对值几百的异常

原文链接:50s完成7B模型量化,4bit达到新SOTA,大模型低比特量化有新招了 | NeurIPS 2024 Oral

联系作者

文章来源:量子位

作者微信:

作者简介:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号