AIGC动态欢迎阅读

原标题:不让视觉语言模型「盲猜」,性能竟直接提升一倍?

关键字:模型,视觉,问题,基准,语言

文章来源:机器之心

内容字数:0字

内容摘要:

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com团队的共同一作林之秋(Zhiqiu Lin)是卡内基梅隆大学的博士研究生,由Deva Ramanan教授指导,专注于视觉-语言大模型的自动评估与优化。团队的马紫晛(Zixian Ma)是华盛顿大学的博士研究生,由Ranjay Krishna教授指导,专注于视觉-语言大模型的评测以及与人的交互。

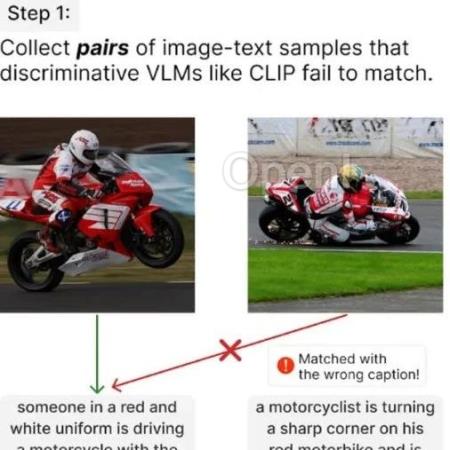

在诸如 MME、MMBench、MMMU 和 ScienceQA 等复杂的视觉问答(VQA)基准上,GPT-4o、Qwen2-VL 等视觉语言模型已经取得了显著进展。然而,这些模型真的理解自然图像吗?近日,卡内基梅隆大学与华盛顿大学的研究团队推出了 NaturalBench,这是一项发表于 NeurIPS’24 的以视觉为核心的 VQA 基准。它通过自然图像上的简单问题

联系作者

文章来源:机器之心

作者微信:

作者简介:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...