INFP – 音频驱动的生成逼真面部表情和头部姿态的AI框架

INFP是什么

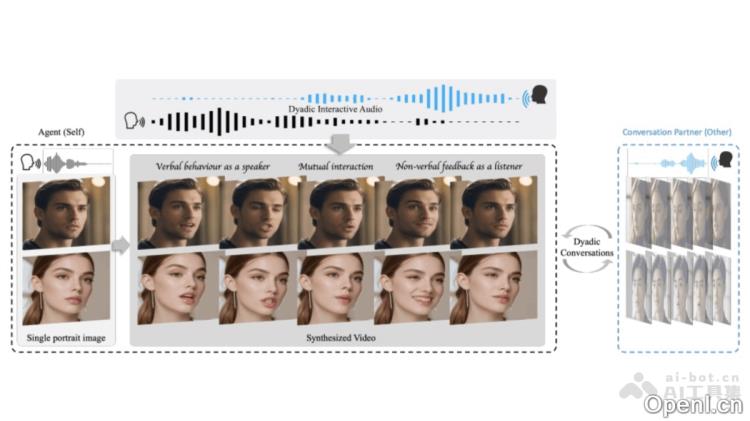

INFP是一个音频驱动的头部生成框架,专门为双人对话交互而设计。该框架能够根据对话音频自动进行角色转换,无需手动分配或切换角色。INFP的工作流程包括两个阶段:首先是基于动作的头部模仿阶段,其次是音频引导的动作生成阶段。通过实验和可视化分析,INFP展现出了出色的性能和有效性。此外,INFP还提出了大规模的双人对话数据集DyConv,以推动该领域的研究进展。

INFP的主要功能

- 自动角色转换:INFP可以在双人对话中自动完成角色切换,消除了手动操作的需求,使得交互过程更加自然和流畅。

- 轻量高效:该框架在保持强大功能的同时,具备轻量化特性。在Nvidia Tesla A10上,INFP可以实现超过40 fps的实时推理速度,支持智能代理之间或人与代理之间的实时互动。

- 交互式头部生成:INFP的两个关键阶段包括基于的头部模仿和音频驱动的动作生成。第一阶段将真实对话视频中的面部表情行为编码到低维潜在空间,而第二阶段则将输入音频映射到这些潜在代码,从而实现音频驱动的头部生成。

- 大规模双人对话数据集DyConv:为了促进研究领域的发展,INFP引入了DyConv数据集,该数据集从互联网上收集了丰富的双人对话数据。

INFP的技术原理

- 头部模仿阶段:在此阶段,框架学习将现实生活中的对话视频中的面部交流行为投影到一个低维潜在空间。这个过程涉及从大量真实对话视频中提取面部交流行为,并将其编码为可以驱动静态图像动画的潜在代码。

- 音频引导动作生成阶段:在第二阶段,框架学习将输入的双通道音频映射到潜在代码。这一过程通过去噪操作来实现,从而在交互场景中实现音频驱动的头部生成。

- 实时互动与风格控制:INFP支持实时互动,允许用户在对话中随时打断或回应虚拟形象。此外,通过提取任意肖像视频的风格向量,INFP可以全局控制生成结果中的情绪或态度。

INFP的项目地址

INFP的应用场景

- 视频会议与虚拟助手:INFP框架提供真实感、交互性和实时性的体验,适用于视频会议和虚拟助手等实时场景,带来更为自然和流畅的互动体验。

- 社交媒体与互动娱乐:在社交媒体平台或互动娱乐应用中,INFP可用于生成具有自然表情和头部动作的交互式头像,增强用户的互动感受。

- 教育培训:INFP能够创建虚拟教师或培训师,提供生动而互动的教学体验。

- 客户服务:在客户服务领域,INFP可以生成虚拟客服代表,提供更加人性化的服务。

- 广告与营销:INFP可以生成引人注目的虚拟代言人,用于广告和营销活动,提供更为逼真和互动的广告体验。

- 游戏与模拟:在游戏和模拟环境中,INFP能够创建更为真实和互动的角色,提升游戏的沉浸感和互动性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...