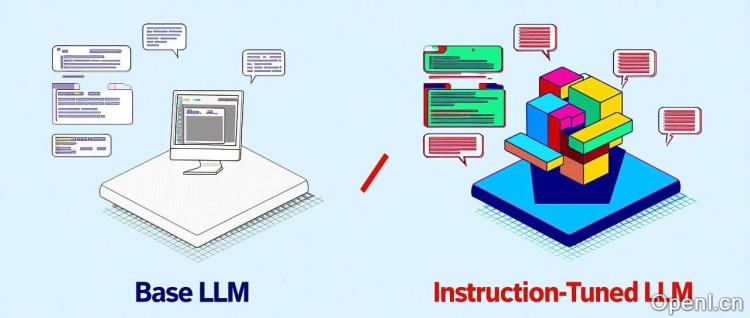

Base LLM 是通过自监督学习预训练的语言模型。具备强大的文本生成能力,但在执行具体任务时缺乏指令理解能力。\x0d\x0a\x0d\x0aInstruction-Tuned LLM 在 Base LLM 的基础上进行了指令微调,使其更善于处理人类提供的任务指

原标题:一文说清楚什么是基础模型(Base LLM)、指令微调模型(Instruction-Tuned LLM)

文章来源:AI取经路

内容字数:6573字

大语言模型的两种形态:基础模型与指令微调模型

近年来,大语言模型(LLM)在自然语言处理领域取得了显著进展,成为推动人工智能发展的重要力量。然而,LLM并非铁板一块,其内部存在着不同的类别,理解这些类别之间的差异对于有效地应用和开发LLM至关重要。本文将重点探讨两种主要的LLM类型:基础模型(Base LLM)和指令微调模型(Instruction-Tuned LLM)。

1. 基础大语言模型(Base LLM):语言学习的基石

基础大语言模型是所有大语言模型的起点。它们通过自监督学习的方式,在海量文本数据中学言的结构和模式。想象一下,一个孩子通过阅读大量的书籍和聆听无数的对话来学言,Base LLM的工作原理与此类似。它们的目标是掌握语言的语法、语义和一定的常识,从而能够预测下一个单词或补全缺失的文本片段。

1.1 预训练:模型的语言学习

Base LLM的预训练过程通常需要消耗巨大的计算资源和大量的文本数据,例如互联网上的文本、书籍、代码等等。在这个过程中,模型学习的是语言本身的规律,而非针对特定任务的知识。

1.2 Base LLM的特点

Base LLM擅长于生成通用的文本,但缺乏对特定任务的理解和执行能力。它们生成的文本可能在语法上正确,但可能无法准确地回应用户的指令或偏离主题。

1.3 Base LLM的应用场景

Base LLM本身并不直接应用于实际任务,而是作为其他更高级模型的基础。研究人员通常会基于Base LLM进行进一步的微调,使其适应特定的领域或任务。

1.4 Base LLM的局限性

由于缺乏对指令的明确理解,Base LLM直接应用于实际场景时往往效果不佳。例如,你可能会得到一个语确的答案,但却与你的实际需求相差甚远。这就像一个掌握了语言规则的孩子,却不知道如何完成特定的任务。

2. 指令微调大语言模型(Instruction-Tuned LLM):任务执行的专家

指令微调大语言模型是在基础模型的基础上,经过额外的指令微调训练而成的。这个过程就像对一个已经掌握了语言的孩子进行专门的培训,使其能够胜任特定的工作。

2.1 指令微调:模型的任务训练

指令微调通常包含两个阶段:监督微调(SFT)和强化学习(RLHF)。SFT使用包含指令和相应答案的数据集来训练模型,让模型学习如何理解和执行不同的指令。RLHF则通过人类反馈来进一步优化模型的输出,使其更符合人类的期望。

2.2 Instruction-Tuned LLM的特点

Instruction-Tuned LLM能够更好地理解和执行人类指令,生成更准确、更符合用户需求的文本。它们在各种需要自然语言理解和生成的实际应用中表现出色。

2.3 Instruction-Tuned LLM的应用场景

Instruction-Tuned LLM广泛应用于机器人、智能助手、问答系统等需要与用户进行交互的场景,以及文本摘要、翻译、代码生成等需要执行特定任务的场景。

2.4 Instruction-Tuned LLM的安全性和对齐

为了确保Instruction-Tuned LLM的安全性和可靠性,通常会采取一些措施,例如输入过滤、输出约束和价值观对齐等,以防止模型生成有害或不合适的输出。

3. Base LLM与Instruction-Tuned LLM的对比

Base LLM和Instruction-Tuned LLM并非相互对立,而是LLM发展过程中的两个重要阶段。Base LLM提供强大的语言理解能力,而Instruction-Tuned LLM则在此基础上增加了对指令的理解和执行能力,从而实现了更广泛的应用。

两者之间的主要区别在于训练方式和应用场景。Base LLM主要通过自监督学习进行训练,而Instruction-Tuned LLM则通过指令微调进行训练,使其更善于理解和执行人类指令。Base LLM更适合作为研究和开发的基础,而Instruction-Tuned LLM更适合直接应用于实际场景。

4. 总结

理解Base LLM和Instruction-Tuned LLM的区别,有助于我们更好地选择和应用大语言模型,从而更好地利用人工智能技术为人类服务。

联系作者

文章来源:AI取经路

作者微信:

作者简介:踏上取经路,比抵达灵山更重要! AI技术、 AI知识 、 AI应用 、 人工智能 、 大语言模型