DragAnything – 快手联合浙大等机构开源的可控视频生成方法

DragAnything是什么

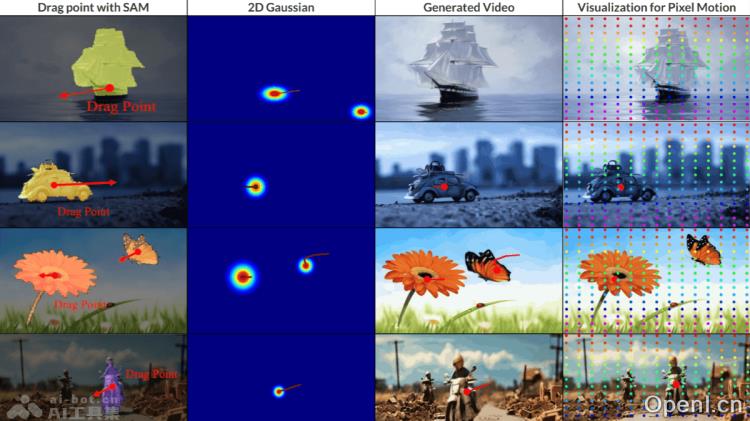

DragAnything 是由快手与浙江大学和新加坡国立大学 Show Lab 联合开发的一种基于实体表示的视频生成技术。该方法通过简单的轨迹输入,实现了对视频中任意物体的精确控制。DragAnything 利用扩散模型的潜在特征表示每个视频实体,克服了传统方法仅依赖拖动像素点而无法精确控制物体的局限性。该系统为用户提供了友好的交互界面,灵活支持前景、背景及相机的控制,并在 FID、FVD 等评估指标上创造了新的最佳表现。

DragAnything的主要功能

- 实体级控制:支持对视频中任意实体(包括前景和背景)的精准控制,超越了单纯的像素级操作。

- 多实体控制:能够同时对多个物体执行的控制,每个物体的依据用户定义的轨迹进行调整。

- 友好的用户交互:用户可通过简单的选择和拖动操作来实现复杂的控制,无需使用如分割掩码或深度图等复杂输入信号。

- 相机控制:除了物体控制,DragAnything 还能实现相机的缩放和平移等控制。

- 高质量视频生成:在保持控制准确性的同时,生成高品质的视频内容,适用于多种应用场景。

DragAnything的技术原理

- 实体表示:采用新的实体表示方法,从扩散模型的潜在特征中提取语义信息,以表征视频中的每个物体,结合物体的语义特征与轨迹,实现精准的实体级控制。

- 2D 高斯表示:引入 2D 高斯表示,通过高斯分布为物体的中心区域赋予更高权重,降低边缘像素的干扰,从而实现更自然的控制。

- 扩散模型:基于扩散模型架构(如 Stable Video Diffusion),利用其强大的生成和去噪能力生成高质量的视频内容。扩散模型通过逐步去除噪声来重建视频帧,并结合用户输入的轨迹和实体表示。

- 轨迹引导的控制:用户通过绘制简单的轨迹定义物体的路径,DragAnything 将轨迹与实体表示相结合,生成符合用户意图的视频内容,避免了直接操作像素点的局限性,实现更自然和精准的控制。

- 损失函数与优化:在训练过程中,采用带有掩码的均方误差(MSE)损失函数,专注于优化用户指定区域的控制,同时保持其他区域的生成质量。

DragAnything的项目地址

- 项目官网:https://weijiawu.github.io/draganything

- GitHub仓库:https://github.com/showlab/DragAnything

- arXiv技术论文:https://arxiv.org/pdf/2403.07420

DragAnything的应用场景

- 视频创作与编辑:快速生成动画,调整物体轨迹,从而提高创作效率。

- 游戏开发:生成角色动作,增强玩家的互动体验。

- 教育与培训:辅助科学模拟和技能培训,帮助理解复杂的过程。

- 广告与营销:制作动态广告和产品展示,突出产品特色。

- 娱乐与社交:生成互动视频和控制虚拟角色动作,增强趣味性。

常见问题

- DragAnything适用于哪些平台? DragAnything 可以在多种操作系统上运行,具体取决于用户的需求与开发环境。

- 使用DragAnything需要哪些技能? 用户只需具备基本的计算机操作能力,即可轻松使用 DragAnything,无需专业的编程技能。

- DragAnything的输出视频质量如何? DragAnything 能够生成高质量的视频,适合多种应用场景,并保持控制的精确性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...