利用「历史帧」成为关键。

原标题:千帧长视频时代到来!MIT全新扩散算法让任意模型突破时长极限

文章来源:机器之心

内容字数:5364字

MIT团队突破长视频生成瓶颈:Diffusion Forcing Transformer (DFoT) 算法详解

机器之心AIxiv专栏报道了麻省理工学院团队一项突破性研究,该研究提出了一种名为Diffusion Forcing Transformer (DFoT) 的全新算法,显著提升了视频扩散模型的生成长度和质量。这项工作解决了长视频生成这一长期困扰视频扩散模型的难题,生成的视频长度可达近千帧,是之前模型的近50倍。

1. 长视频生成的挑战与DFoT的创新

现有的视频扩散模型通常只利用第一帧进行无分类器引导(CFG),忽略了其他历史帧的重要信息。MIT团队的研究发现,历史信息是提升视频生成质量的关键。DFoT算法巧妙地解决了这个问题。它在不改变原有架构的情况下,通过引入“噪声掩码”机制,使得模型能够灵活地利用不同长度、不同子集甚至不同频率域的历史信息进行去噪预测。这使得DFoT能够在各种场景下,例如图生视频或延长已有视频,都展现出优异的性能。

2. DFoT算法的核心机制:噪声掩码

DFoT的核心在于其“噪声掩码”机制。该机制借鉴了Diffusion Forcing的概念,通过控制每一帧的噪声强度来实现对历史信息的灵活利用。无噪声的帧被直接作为条件信息,而高噪声的帧则被忽略。这种方法使得模型能够根据需要选择不同长度的历史信息作为条件,从而实现了对各种历史信息的灵活利用。 这种设计也保证了现有模型可以方便地微调成DFoT模型,Adobe公司已经在其视频大模型CausVid上验证了Diffusion Forcing的微调效果。

3. 历史引导算法:提升质量与鲁棒性

基于DFoT的灵活性和对历史信息的有效利用,研究团队提出了一系列“历史引导”算法。这些算法扩展了无分类器引导的概念,通过组合有条件模型和无条件模型,以及加权去噪组合多重不同历史条件,进一步提升了视频生成质量、长度、鲁棒性和可组合性。例如,Temporal History Guidance增强了鲁棒性,Fractional History Guidance则提升了动作幅度。

4. 实验结果:显著超越现有模型

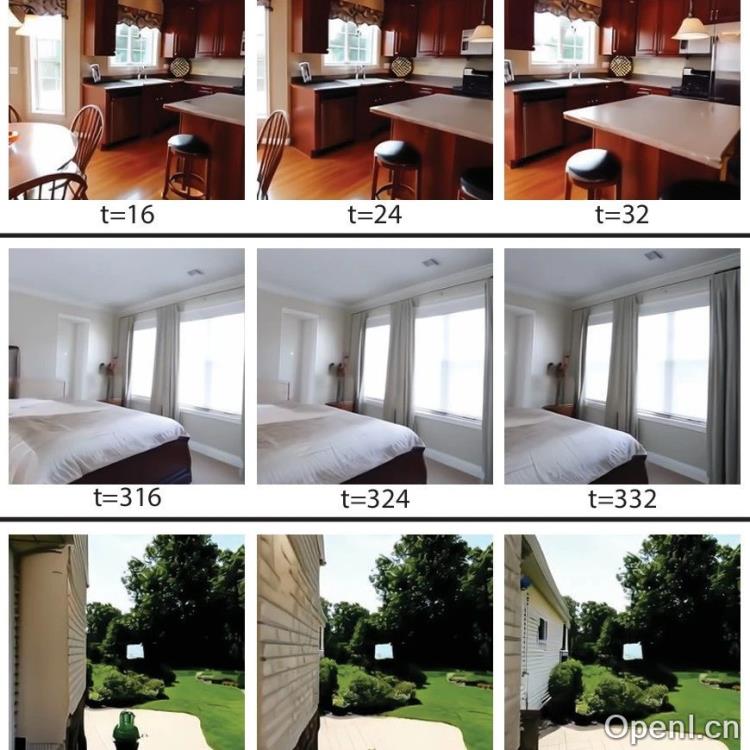

在Kinetics 600和RealEstate10K数据集上的实验结果表明,DFoT算法显著优于其他同架构的视频扩散算法,甚至与谷歌的闭源大模型性能相当。在RealEstate10K数据集上,DFoT能够从单图生成近千帧视频,而之前的模型最多只能生成几十帧。这充分展现了DFoT算法的强大性能。

5. 开源与未来展望

该研究成果已开源,并在Huggingface平台上提供了在线体验。 DFoT的出现,为长视频生成领域带来了新的突破,为未来的视频生成技术发展提供了新的方向。 未来研究方向包括进一步提升生成视频的质量和效率,以及探索DFoT在其他领域的应用。

联系作者

文章来源:机器之心

作者微信:

作者简介:专业的人工智能媒体和产业服务平台