AIGC动态欢迎阅读

原标题:任意文本、视觉、音频混合生成,多模态有了强大的基础引擎CoDi-2

文章来源:机器之心

内容字数:5573字

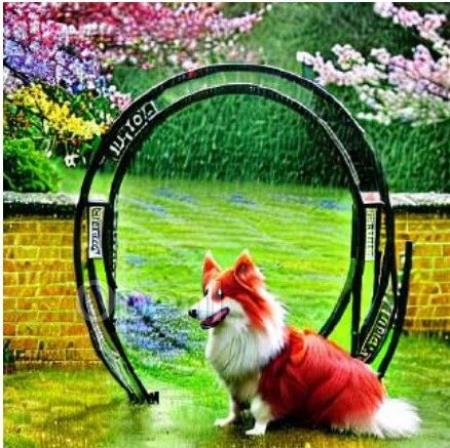

内容摘要:机器之心报道编辑:杜伟、大盘鸡研究者表示,CoDi-2 标志着在开发全面的多模态基础模型领域取得了重大突破。今年 5 月,北卡罗来纳大学教堂山分校、微软提出一种可组合扩散(Composable Diffusion,简称 )模型,让一种模型统一多种模态成为可能。CoDi 不仅支持从单模态到单模态的生成,还能接收多个条件输入以及多模态联合生成。近日,UC 伯克利、微软 Azure AI、Zoom、北卡罗来纳大学教堂山分校等多个机构的研究者将 CoDi 升级到了 CoDi-2。论文地址:https://arxiv.org/pdf/2311.18775.pdf项目地址:https://codi-2.github.io/项目 demo论文一作 Zineng Tang 表示,「CoDi-2 遵循复杂的多模态交错上下文指令,以零样本或少样本交互的方式生成任何模态(文本、视觉和音频)。」图源:https:…

原文链接:点此阅读原文:任意文本、视觉、音频混合生成,多模态有了强大的基础引擎CoDi-2

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业的人工智能媒体和产业服务平台

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备 44011502001135号

粤公网安备 44011502001135号